Coisas que eu quero fazer

Execute o SD3.5-medium (stable-diffusion-3.5-medium) a partir da linha de comando usando o arquivo stable-diffusion.cpp.

Há rumores de que seja rápido e de boa qualidade.

Ele pode ser executado tanto em GPUs quanto em CPUs da AMD.

configuração do ambiente

difusão-estável.cpp

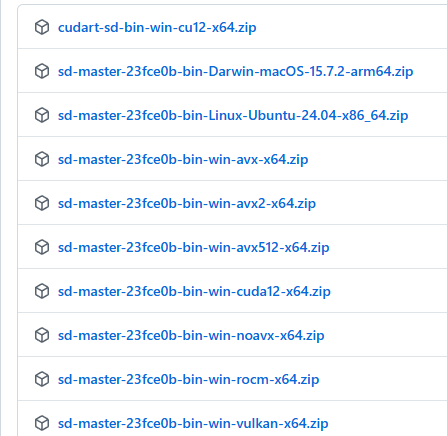

Faça o download do arquivo Zip apropriado para o seu ambiente na página seguinte.

Se você quiser executá-lo em uma GPU AMD, precisará de algo com ‘vulkan’ ou ‘rocm’ no nome.

(Basicamente, o Vulkan deve funcionar bem. O ROCM provavelmente terá limitações quanto às GPUs que podem ser usadas.)

Isso se aplica às GPUs da NVidia que têm CUDA em seu nome.

AVX512, AVX2, AVX e NOAVX são baseados na CPU. Verifique qual versão do AVX é compatível com sua CPU e faça o download. (Eu estava enganado, mas parece que as CPUs da AMD também podem usar AVX. É mais fácil perguntar a um especialista em IA qual versão é compatível.)

Depois de extrair o arquivo baixado para uma pasta de sua escolha, você estará pronto para começar.

Modelo

Faça o download de um modelo na página seguinte. (Quanto maior o número após o Q, melhor o desempenho e maior o tempo de geração.)

Em seguida, baixe um dos arquivos t5xxl_XXXXX.safetensors, juntamente com clip_g.safetensors e clip_l.safetensors (um total de três arquivos) na página seguinte.

Em seguida, baixe o arquivo diffusion_pytorch_model.safetensors da página a seguir. Observe que você precisará fazer login no Hugging Face e concordar com os termos de uso para baixá-lo. (Após fazer login e acessar a aba do modelo, uma interface para concordar com os termos será exibida.)

execução

Abra a linha de comando e navegue até a pasta onde você extraiu o arquivo stable-diffusion.cpp.

Execute o seguinte comando. (Substitua o caminho do modelo pelo caminho do modelo que você está usando.)

sd-cli.exe --diffusion-model ModelPath --clip_l clip_l.safetensorsPath --vae diffusion_pytorch_model.safetensorsPath --clip_g clip_g.safetensorsPath --t5xxl t5xxl_XXXX.safetensorsPath -H 512 -W 512 -p "a lovely cat" --cfg-scale 4.5 --sampling-method euler -v --clip-on-cpu

Se uma imagem de gato for gerada na pasta onde você executou o comando, significa que a operação foi bem-sucedida.

Opções (argumentos)

As opções estão resumidas na página seguinte.

Abaixo estão listados apenas os modelos básicos mais comuns.

| -m | Caminho do modelo |

| -p | incitar |

| -s | Valor inicial Especifique -1 para gerar aleatoriamente. Observe que, se você não especificar um formato, a mesma imagem será gerada todas as vezes. |

-H | Altura da imagem |

| -EM | Largura da imagem |

--pé | via VAE |

--passos | Etapa. Valor inicial: 20 Note que, para alguns modelos, um número menor pode ser melhor. (O exemplo oficial da Qwen Image era 50.) |

Velocidade de execução

A velocidade de geração de imagens é a seguinte: (Isso não inclui o tempo de carregamento do modelo nem o tempo após a iteração.)

| Modelo | CreationTime(s) |

| difusão estável (Vulkan) | 36 |

| Imagem da Rainha (Vulkan) | 623 |

| SD3.5-médio (Vulcan) | 56 |

Na minha opinião pessoal, como já se comentava, a qualidade da imagem é superior à do StableDiffusion e parece ter um equilíbrio melhor do que os dois modelos com os quais o comparei.

コメント