Coisas que eu quero fazer

Adicione o modelo à interface web do Stable Diffusion que está sendo executada localmente.

Environment

difusão estável-webui-amdgpu

Baixe o modelo

download

Você pode baixá-lo na página seguinte.

Você pode baixar o modelo clicando no botão no lado direito da página de cada modelo.

(No entanto, alguns modelos exigem login.)

licença

A licença de cada modelo está listada na caixa vermelha abaixo do botão de download, portanto, verifique-a antes de usar. (Muitos modelos aparentemente não possuem restrições de uso.)

Modelos recomendados

Nostalgia pura

Este é um modelo para gerar imagens no estilo anime.

Sonho Real

Este é um modelo para gerar imagens que se parecem com a vida real.

Instalação do modelo

Copie o arquivo baixado para a seguinte pasta.

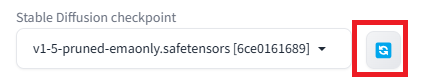

インストールフォルダ\models\Stable-diffusionApós a conclusão da cópia, clique no botão na parte inferior da interface gráfica.

Assim que o processo estiver concluído, você poderá selecionar o modelo baixado no menu suspenso à esquerda do botão.

Quando a transição não corre bem

A transição ainda não foi concluída.

Se o interruptor não funcionar corretamente (ou estiver lento), clicar novamente no botão de atualização pode resolver o problema.

Falha ao criar o modelo rapidamente; tentará novamente usando o método mais lento.

Se você se deparar com o seguinte erro durante a troca ou inicialização, e o sistema estiver lento, isso às vezes pode ser resolvido modificando o código.

Vou modificar o roteiro.

Prossiga por sua conta e risco.

Failed to create model quickly; will retry using slow method.Abra o seguinte arquivo.

インストールフォルダ¥modules¥sd_disable_initialization.pyEncontre o seguinte código.

def CLIPTextModel_from_pretrained(pretrained_model_name_or_path, *model_args, **kwargs):

res = self.CLIPTextModel_from_pretrained(None, *model_args, config=pretrained_model_name_or_path, state_dict={}, **kwargs)

res.name_or_path = pretrained_model_name_or_path

return resSubstitua o código acima pelo seguinte: (Substitua None por pretrained_model_name_or_path.)

def CLIPTextModel_from_pretrained(pretrained_model_name_or_path, *model_args, **kwargs):

res = self.CLIPTextModel_from_pretrained(pretrained_model_name_or_path, *model_args, config=pretrained_model_name_or_path, state_dict={}, **kwargs)

res.name_or_path = pretrained_model_name_or_path

return res

コメント