我想做的事情

使用 stable-diffusion.cpp 从命令行运行 SD3.5-medium (stable-diffusion-3.5-medium)。

据说它速度快,质量好。

它既可以在 AMD 的 GPU 上运行,也可以在 AMD 的 CPU 上运行。

环境设置

稳定扩散.cpp

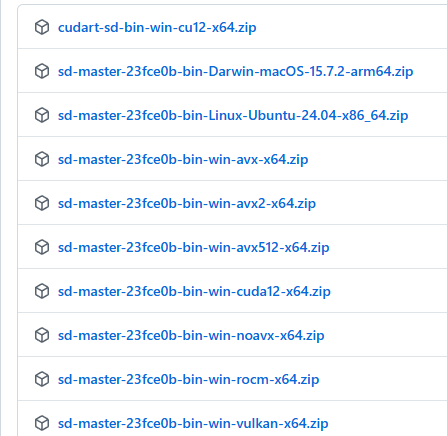

请从以下页面下载适合您环境的 Zip 文件。

如果你想在 AMD GPU 上运行它,你需要一个名称中带有vulkan或rocm 的程序。

(基本上,Vulkan 应该没问题。ROCM 可能会对可使用的 GPU 有限制。)

这适用于名称中带有CUDA 的英伟达 GPU。

AVX512、AVX2、AVX 和 NOAVX 都是基于 CPU 的指令集。请检查哪个 AVX 版本与您的 CPU 兼容并下载。(我之前弄错了,但 AMD CPU 似乎也可以使用 AVX。最简单的办法是咨询 AI 以确定哪个版本兼容。)

将下载的文件解压到你选择的文件夹后,就可以开始了。

模型

请从以下页面下载一个模型。(Q后面的数字越大,性能越好,生成时间越长。)

接下来,从以下页面下载 t5xxl_XXXXX.safetensors 文件之一,以及 clip_g.safetensors 和 clip_l.safetensors 文件(共三个文件)。

接下来,请从以下页面下载 diffusion_pytorch_model.safetensors。请注意,您需要登录 Hugging Face 并同意其使用条款才能下载。(登录后,进入模型卡片标签页,将显示同意条款的界面。)

执行

启动命令行并导航到您解压 stable-diffusion.cpp 的文件夹。

执行以下命令。(将模型路径替换为您所使用的模型的路径。)

sd-cli.exe --diffusion-model ModelPath--clip_l clip_l.safetensorsPath --vae diffusion_pytorch_model.safetensorsPath --clip_g clip_g.safetensorsPath --t5xxl t5xxl_XXXX.safetensorsPath -H 512 -W 512 -p "a lovely cat" --cfg-scale 4.5 --sampling-method euler -v --clip-on-cpu

如果在执行命令的文件夹中生成了猫的图像,则表示命令执行成功。

选项(参数)

选项汇总如下页。

以下仅列出最常用的基本功能。

| -m | 模型路径 |

| -p | 迅速的 |

| -s | 种子价值 指定-1以随机生成。 请注意,如果您不指定格式,则每次都会生成相同的图像。 |

-H | 图片高度 |

| -在 | 图片宽度 |

- 脚 | VAE路径 |

步骤 | 步骤。初始值:20 请注意,对于某些型号,较低的数值可能更好。 (Qwen Image提供的官方示例为50。) |

执行速度

图像生成速度如下:(不包括模型加载时间或迭代后的时间。)

| 模型 | 生成时间(秒) |

| 稳定扩散(Vulkan) | 36 |

| Qwen Image(Vulkan) | 623 |

| SD3.5-中等(Vulcan) | 56 |

就我个人而言,正如传闻所说,它的图像质量比 StableDiffusion 更高,而且似乎比我对比过的另外两个模型具有更好的平衡性。

コメント