我想做的事情

使用 stable-diffusion.cpp 从命令行执行 Qwen-Image 图像编辑。

这项图像编辑功能显然可以与谷歌的NanoBanana相媲美。

它既可以在 AMD 的 GPU 上运行,也可以在 AMD 的 CPU 上运行。

环境设置

稳定扩散.cpp

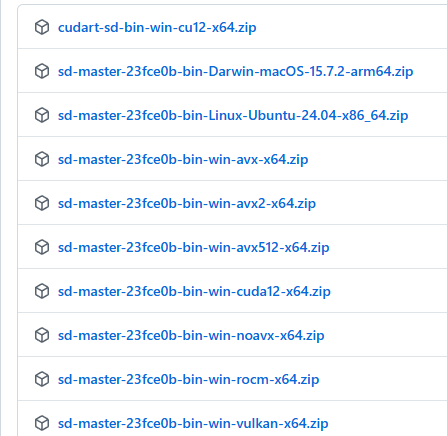

请从以下页面下载适合您环境的 Zip 文件。

如果你想在 AMD GPU 上运行它,你需要一个名称中带有vulkan或rocm 的程序。

(基本上,Vulkan 应该没问题。ROCM 可能会对可使用的 GPU 有限制。)

这适用于名称中带有CUDA 的英伟达 GPU。

AVX512、AVX2、AVX 和 NOAVX 都是基于 CPU 的指令集。请检查哪个 AVX 版本与您的 CPU 兼容并下载。(我之前弄错了,但 AMD CPU 似乎也可以使用 AVX。最简单的办法是咨询 AI 以确定哪个版本兼容。)

将下载的文件解压到你选择的文件夹后,就可以开始了。

模型

请从以下页面依次下载这三个模型。

Vae模型和LLM模型与下文中使用的模型相同。(请注意,扩散模型有所不同。)

对于由多个文件组成的文件,较大的文件大小需要更多的内存,但精度会更高。

请根据您的使用环境决定使用哪种型号。

在我的环境中(Ryzen 7 7735HS 搭配 Radeon 显卡 + 32GB 内存),我使用了 Qwen_Image_Edit-Q4_0.gguf。

扩散模型(Qwen 图片编辑)

脚

llm

执行

启动命令行并导航到您解压 stable-diffusion.cpp 的文件夹。

执行以下命令。(将模型路径替换为您使用的模型路径。将输入文件设置为输入图像的路径。)

sd-cli.exe --diffusion-model 扩散模型路径 --vae VAE 模型路径 --llm llm 模型路径 --cfg-scale 2.5 --sampling-method euler --offload-to-cpu --diffusion-fa --flow-shift 3 -r 输入文件 -p将眼睛颜色更改为红色--seed -1

如果输出文件 ./output.png 包含输入图像但眼睛是红色的图像,则表示处理成功。

输入图像

输出图像

(在上面的例子中,效果很好,但是如果使用“闭上眼睛”提示,输入的图像就会原样输出。)

选项(参数)

选项汇总如下页。

以下仅列出最常用的基本功能。

| -m | 模型路径 |

| -p | 迅速的 |

| -s | 种子价值 指定-1以随机生成。 请注意,如果您不指定格式,则每次都会生成相同的图像。 |

-H | 图片高度 |

| -在 | 图片宽度 |

- 脚 | VAE路径 |

步骤 | 步骤。初始值:20 请注意,对于某些型号,较低的数值可能更好。 (Qwen Image提供的官方示例为50。) |

执行速度

图像生成速度如下:(不包括模型加载时间或迭代后的时间。)

| 模型 | 创建时间(s) |

| 稳定扩散(Vulkan) | 36 |

| Qwen Image(Vulkan) | 623 |

| Qwen图像编辑(Vulkan) | 1683 |

关于 Qwen 图片编辑 2509

Qwen Image Edit 2509 的模型可以在下一页找到。

在我将扩散模型替换为我在下面下载的模型路径后,上述 Qwen Image Edit 执行命令生效了。

The official documentation mentions adding `--llm_vision` when running Qwen Image Edit 2509, but I was unable to run it with this argument. (This might be an environment issue.)执行结果

创建时间:2034.03秒

这或许只是巧合,但Queen Image Edit 2509 中的“闭眼”功能也非常好用。

コメント